Het slimme hoortoestel komt eraan

Hersenen kunnen zelfs in een lawaaierige omgeving spraak herkennen en verstaan. Computers en hoorapparaten kunnen dit niet; zij kunnen hun aandacht niet richten. Maastrichtse onderzoekers zien mogelijkheden om deze apparaten meer te laten werken zoals het menselijk brein. Zo kan je met een hoortoestel zelf bepalen welk geluid versterkt wordt. En weet de computer wanneer je iets tegen hem zegt en wanneer niet.

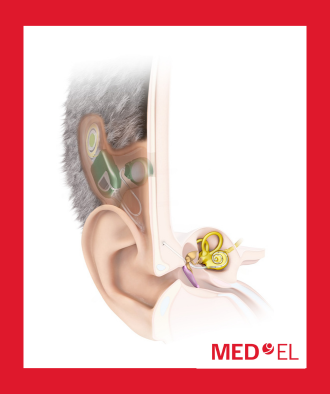

Een half miljard mensen wereldwijd lijdt aan een al dan niet ernstige mate van gehoorverlies. Binnen een jaar of vijf zijn dat er 700 miljoen. Waarmee de explosieve stijging van het aantal dragers van een gehoortoestel verklaard is. Het kan voor mensen het verschil zijn tussen werken en niet-werken, tussen een sociaal isolement of een `normaal` leven.

Geen wondermiddel

Maar een hoortoestel is geen wondermiddel. Vooral in omgevingen met veel geluid schiet het apparaat tekort. Alle geluid komt tegelijk versterkt binnen waardoor de drager wel veel lawaai hoort, maar amper in staat is een gesprek te volgen. "Een gehoorapparaat versterkt alle geluiden en is niet in staat alleen het geluid te versterken dat jij wilt horen", zegt Lars Riecke, Duitser van geboorte en sinds acht jaar verbonden aan de Faculty of Psychology and Neurosciences van de Universiteit Maastricht. "Hersenen kunnen dat wel. Als je op een druk station mobiel staat te bellen dan kun je de ander verstaan. Ondanks allerlei andere geluiden en ruis. Als je een microfoon in je oor zou plaatsen, zou dat nooit lukken. Dan zou je andere geluiden veel harder horen en dus geen gesprek kunnen voeren. Hersenen kunnen ook informatie die wegvalt door ruis en bijgeluiden repareren. Ze vullen als het ware de informatiegaten op. Zo kun je een telefoongesprek voeren te midden van het lawaai. "

Tijdens een popconcert produceert de band vaak een flink aantal decibels meer dan de vriend die naast je staat. Toch lukt het je om je vriend te verstaan, doordat je hersenen je aandacht kunnen richten. Een hoortoestel kan dit niet en zal dus alle geluid versterken. Of het nu is wat je probeert te horen of niet.

Tijdens een popconcert produceert de band vaak een flink aantal decibels meer dan de vriend die naast je staat. Toch lukt het je om je vriend te verstaan, doordat je hersenen je aandacht kunnen richten. Een hoortoestel kan dit niet en zal dus alle geluid versterken. Of het nu is wat je probeert te horen of niet.

Scanner en EEG

Dat hersenen dat kunnen, is overigens al een halve eeuw bekend. "Maar met de huidige generatie scanners kunnen we zien hoe de hersenen dat doen", zegt Lars Riecke. "De afgelopen vier jaar hebben we een aantal mensen onder de fMRI-scanner gelegd en hen heel eenvoudige signaaltonen in verschillende variaties laten horen. Via de scanner werd zichtbaar wat er in de hersenen gebeurt, hoe geluid verwerkt wordt en waar precies. Daarnaast hebben we ook EEG-onderzoek gedaan. Met EEG-golven kun je de snelheid van de hersenactiviteit beter meten. Met de combinatie van deze twee onderzoeken heb ik inzicht gekregen in de basale, fundamentele werking van onze hersenen, door heel eenvoudige signaaltonen te gebruiken. "

Tijdens het onderzoek viel Lars Riecke een aantal zaken op. "Als er pauzes vallen in de stem van een spreker of als geluiden niet goed doorkomen, dan schiet de hersenactiviteit omhoog. Is er geen sprake van ruis of bijgeluiden, dan is de hersenactiviteit kalm. Dat sterkt ons in de gedachte dat de hersenen zorgen voor een vloeiend geluid. Ze vullen ook de leemtes in. Incomplete zinnen worden aangevuld met materiaal dat in de hersenen opgeslagen is. Of dat altijd betrouwbaar is? Of je hoort wat je wilt horen? Dat durf ik niet te zeggen. Het gaat om de vloeiendheid, de doorloop. Hoe dan ook, dit systeem is te vertalen naar gehoortoestellen. De eerste contacten met een ingenieursbureau in Bochum zijn gelegd. De technici zouden met de opgedane kennis de gehoorapparaten van nu belangrijk kunnen verbeteren. "

Dankzij de continuïteits illusie vullen onze hersenen missende informatie aan tot een passend geheel. Zo kan je je goed voorstellen hoe dit plaatje onder de streep doorloopt. Ook gaten in geluid vullen de hersenen automatisch aan. Zo`n principe zou ook goed van pas komen in hoortoestellen.

Dankzij de continuïteits illusie vullen onze hersenen missende informatie aan tot een passend geheel. Zo kan je je goed voorstellen hoe dit plaatje onder de streep doorloopt. Ook gaten in geluid vullen de hersenen automatisch aan. Zo`n principe zou ook goed van pas komen in hoortoestellen.

Spraakherkenning

En dat is nog niet alles. De verkregen inzichten kunnen ook toegepast worden in de techniek van spraakherkenning. "Er komt een tijd dat we apparaten niet met knoppen bedienen, maar met spraak. Roep `licht aan` in plaats van op het knopje te drukken. Of `bel mijn moeder` en de telefoonverbinding wordt gelegd. Nu is dat nog moeilijk omdat de stem vaak niet herkend wordt of de uitspraak te onduidelijk is in drukke omgevingen. Ons onderzoek heeft ons geleerd hoe de hersenen de commando`s in achtergrondgeluiden verwerken en dat is technisch toepasbaar. Voor mensen met bepaalde handicaps een mooi perspectief."

Het is nog te vroeg om een concreet tijdspad te benoemen. "Er is meer onderzoek nodig", zegt Lars Riecke. "Veel meer. We hebben nu getest in een onnatuurlijke omgeving in het lab. Een volgende stap is onderzoek in reële situaties. Ik trek wel eens de vergelijking met het zien. Dan bepaal je zelf waar je naar kijkt. De oren zijn natuurlijk niet zo flexibel als het oog. Maar je kunt wel je hoofd bewegen om gedeeltelijk te bepalen hoe goed je iets hoort. Misschien is het ooit mogelijk dat de hersenen bepalen wat je hoort. Anders gezegd, dat je met je gehoorapparaat beslist naar wie of wat je luistert. "

Goede richting

"Maar dan ben ik wel heel ver door aan het denken. Voor de korte termijn zijn we ervan overtuigd dat we een stap in de goede richting hebben gezet. Ons auditief onderzoek kan helpen bij concrete oplossingen voor mensen met gehoorproblemen. En in de wereld van spraakherkenning. De komende jaren hoop ik nog veel meer onderzoek op dit terrein te kunnen starten."

Bron: Kennislink

Reacties